为什么GPU是人工智能算力的支撑?

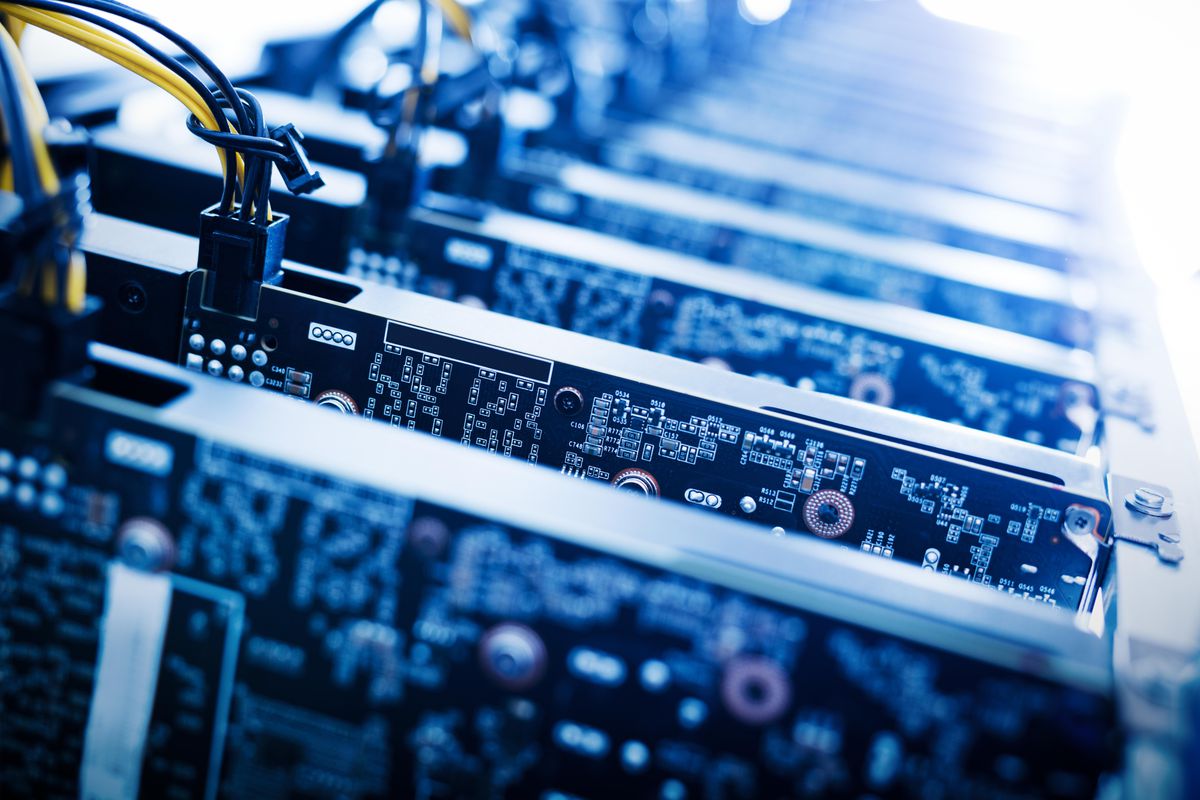

数据、算法和算力是人工智能发展的三大支柱,这三个要素缺一不可。就算力而言,除了训练,AI实际需要运行在硬件上,以及推理(inference),这些都需要算力的支撑,而这需要GPU来承载和实现。

虽然GPU一开始是专门为图形应用开发的硬件组件,在图形渲染中需要进行大量的浮点运算,这些可以并行执行,并且不涉及CPU通常遇到的复杂的分支运算。

GPU提供多核并行计算的基础,且核心数众多,可以支撑大量数据的并行运算。虽然时钟速度和分支处理运算能力都比CPU弱很多,但是这些在训练网络的时候,都是无关紧要的。AI场景训练和推理通常不涉及大量的分支运算与复杂的控制指令,更适合在GPU上进行。

目前,GPU被广泛运用于图形图像处理、数值模拟、机器学习算法训练等领域,Nvidia、AMD、Intel都推出了自己的GPU,其中最为流行的就是NVIDIA的GPU,并推出了CUDA并行编程库。

在过去30年里,摩尔定律一直被证明是正确的,摩尔定律指出了一种趋势,即集成电路上可容纳的晶体管数目,约每隔两年便会增加一倍,半导体行业大致按照摩尔定律发展了半个多世纪,随着器件尺寸越来越接近物理极限,研发新一代的工艺节点时,仅缩小器件尺寸是不够的。多家研究机构和半导体公司都在试图改善晶体管结构设计,以尽可能地延续摩尔定律。

不过随着人工智能时代的到来,AI算法效率已经超越了摩尔定律。曾协助推出 GeForce Experience的前NVIDIA工程师James Wang表示,人工智能(AI)的发展速度比摩尔定律快5到100倍。而根据NIVIDA的说法,GPU计算为行业带来新的发展方式,计算性能将提升至现有水平的1000倍。

GPU的高性能计算推动了AI时代的发展,如自动驾驶、人脸识别与医疗等行业运用深度学习,通过大规模的数据集和神经网络算法进行行业的革新。不过,AI训练对IT架构弹性扩展力有高要求,同时也需要充足的空间进行硬件部署,如果缺乏运维人员,同时会影响AI的内容开发。

在云时代,青椒云GPU云电脑搭载多款高性能GPU,基于异构计算提供超强浮点计算能力服务,提供端到端的深度学习资源,缩短训练环境部署时间,为客户提供更强大的AI算力支持,加速AI落地应用,提供弹性租用服务,用户可根据自身需求灵活定制。